Un investigador de seguridad recibió una recompensa por errores de $ 107,500 por identificar problemas de seguridad en los parlantes inteligentes de Google Home que podrían explotarse para instalar puertas traseras y convertirlas en dispositivos de escucha.

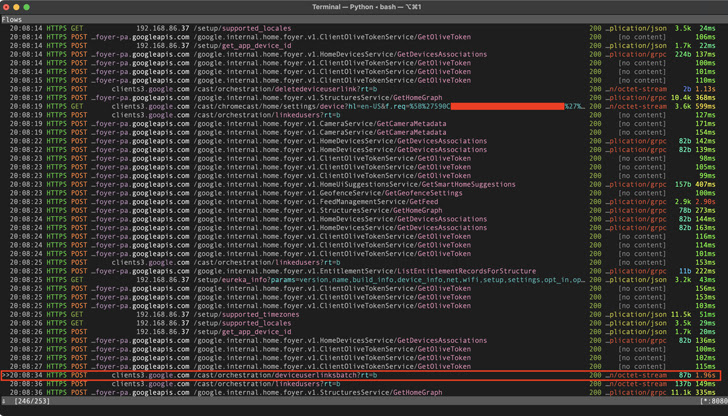

«Las fallas permitieron que un atacante que se encontraba muy cerca de la conexión inalámbrica instalara una cuenta de ‘puerta trasera’ en el dispositivo, lo que le permitía enviarle comandos de forma remota a través de Internet, acceder a la alimentación de su micrófono y realizar solicitudes HTTP aleatorias dentro de la LAN de la víctima. El investigador, a quien se le conoce como Died, una declaración En redacción técnica publicada esta semana.

Cuando se realizan tales solicitudes maliciosas, no solo se puede exponer la contraseña de Wi-Fi, sino que también le da al adversario acceso directo a otros dispositivos conectados a la misma red. Después de la divulgación oficial el 8 de enero de 2021, Google abordó los problemas en abril de 2021.

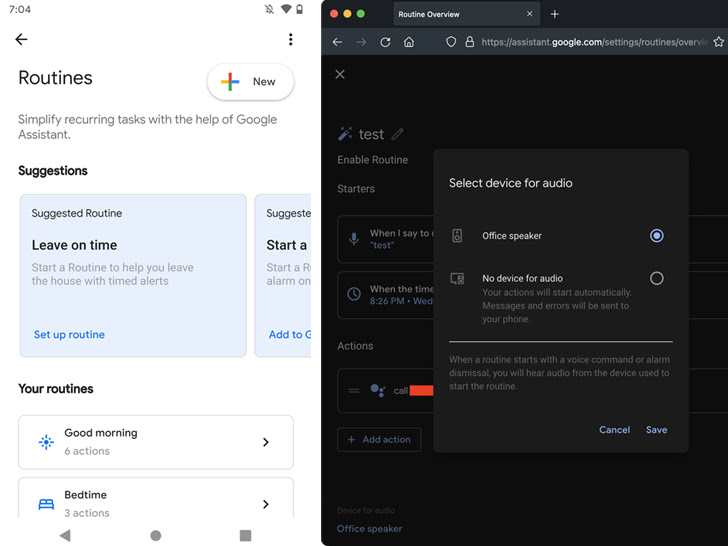

El problema, en pocas palabras, es cómo aprovechar la arquitectura de software de Google Home para agregar una cuenta de usuario de Google no autorizada al dispositivo de automatización del hogar de destino.

En una cadena de ataque detallada por el investigador, un actor de amenazas que busca espiar a una víctima podría engañar a una persona para que instale una aplicación de Android maliciosa que, cuando se detecta un dispositivo Google Home en la red, emite solicitudes HTTP disfrazadas para asociar el cuenta del atacante en el dispositivo de la víctima.

Llevando las cosas a un nivel superior, también parecía que al organizar un Ataque de desautorización de Wi-Fi Para forzar el encendido del dispositivo Google Home Desconectarse de la redse puede hacer que el dispositivo ingrese al modo de configuración y cree su propia red Wi-Fi abierta.

El actor de amenazas puede conectarse más tarde a la red de configuración del dispositivo y Pedir detalles como el nombre del dispositivo, cloud_device_id y el certificado, y utilícelos para asociar su cuenta con el dispositivo.

Independientemente de la secuencia de ataque utilizada, una operación de enlace exitosa le permite al oponente aprovecharla. Acciones de inicio de Google Para disminuir el volumen a cero y Llamar a un número de teléfono específico En cualquier momento para espiar a la víctima a través del micrófono del dispositivo.

«Lo único que una víctima podría notar es que los LED del dispositivo se vuelven azules fijos, pero probablemente supongan que está actualizando el firmware o algo así», dijo Matt. «Durante una llamada, los LED no parpadean como lo harían normalmente cuando el dispositivo está escuchando, por lo que no hay indicación de que el micrófono esté abierto».

Además, el ataque puede extenderse para realizar solicitudes HTTP aleatorias dentro de la red de la víctima e incluso leer archivos o introducir modificaciones maliciosas en el dispositivo asociado que se aplicarán después de un reinicio.

Esta no es la primera vez que se han ideado métodos ofensivos de este tipo para entrometerse en secreto en objetivos potenciales a través de dispositivos activados por voz.

En noviembre de 2019, un grupo de académicos dio a conocer una tecnología llamada comandos de luzlo que indica debilidad micrófonos MEMS Permite a los atacantes inyectar de forma remota comandos inaudibles e invisibles en asistentes de voz populares como Google Assistant, Amazon Alexa, Facebook Portal y Apple Siri usando luz.

«Organizador. Escritor. Nerd malvado del café. Evangelista general de la comida. Fanático de la cerveza de toda la vida.