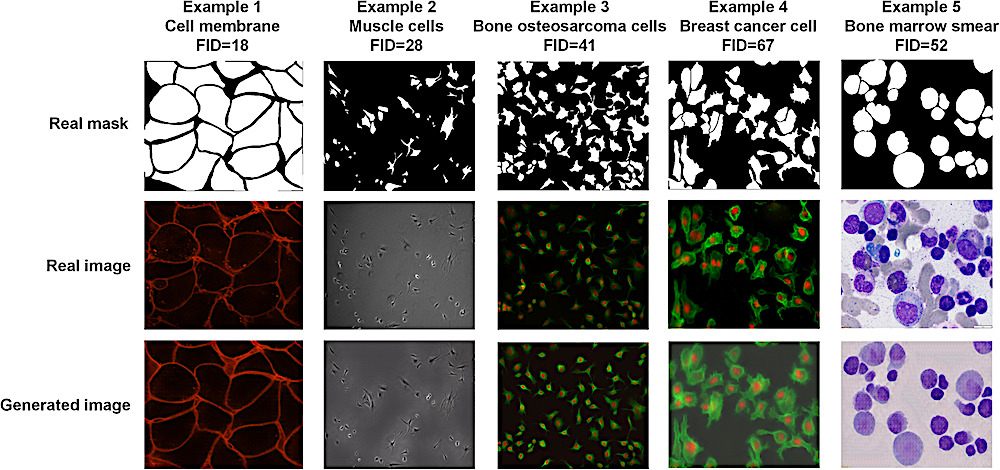

Ejemplos de imágenes reales de diferentes tipos de células versus imágenes sintéticas producidas por el modelo generativo de los investigadores. Crédito a Shariati et al.

Nota del editor: Cuando comencemos a enviar equipos externos a otros mundos para buscar imágenes de formas de vida y luego medirlas, desempeñarán un papel fundamental. Dada la complejidad de tales incursiones, será esencial integrar las capacidades de IA en nuestros compañeros robóticos (y en los sensores/dispositivos que llevamos). Ante la completa incógnita que enfrentaremos, usaremos nuestras herramientas para ayudarnos a descubrir lo que vemos y entrenarnos no sólo a nosotros mismos -sino a nosotros mismos- para comprender lo que nosotros -ellos- vemos.

La observación de células individuales a través de microscopios puede revelar una variedad de fenómenos biológicos celulares importantes que a menudo desempeñan un papel en las enfermedades humanas, pero el proceso de distinguir células individuales entre sí y sus orígenes requiere mucho tiempo, una tarea muy adecuada para ayudar a la inteligencia artificial. .

Los modelos de IA aprenden a realizar dichas tareas utilizando un conjunto de datos que los humanos anotan, pero el proceso de distinguir las células de su entorno, llamado “segmentación unicelular”, requiere mucho tiempo y es arduo. Como resultado, existe una cantidad limitada de datos anotados para su uso en conjuntos de entrenamiento de IA. Los investigadores de UC Santa Cruz han desarrollado una forma de resolver este problema mediante la construcción de un modelo de IA para generar imágenes microscópicas para crear imágenes realistas de células individuales, que luego se utilizan como «datos sintéticos» para entrenar el modelo de IA para que funcione mejor. segmentación celular.

El nuevo software se describe en un nuevo artículo publicado en la revista iScience. El proyecto fue dirigido por el profesor asistente de ingeniería biomolecular Ali Shariati y el estudiante de posgrado Abolfazl Zargari. El modelo, llamado cGAN-Seg, está disponible gratuitamente en GitHub.

«Las imágenes que surgen de nuestro modelo están listas para usarse para entrenar modelos de segmentación», dijo Shariati. “En cierto sentido, estamos haciendo microscopía sin microscopio, ya que podemos generar imágenes que son muy cercanas a las imágenes reales de las células en términos de los detalles morfológicos de cada célula. La belleza de esto es cuando salen. del modelo, ya están anotadas y etiquetadas. Las imágenes muestran muchas similitudes con imágenes reales, lo que luego nos permite crear nuevos escenarios que nuestro modelo no vio durante el entrenamiento.

Las imágenes de células individuales vistas a través de un microscopio pueden ayudar a los científicos a aprender sobre el comportamiento y la dinámica celular a lo largo del tiempo, mejorar la detección de enfermedades y encontrar nuevos medicamentos. Los detalles subcelulares, como la textura, pueden ayudar a los investigadores a responder preguntas importantes, como si una célula es cancerosa.

Encontrar los límites de las células y marcarlos manualmente a partir de su fondo es muy difícil, especialmente en muestras de tejido donde hay muchas células en la imagen. Los investigadores pueden tardar varios días en realizar manualmente la segmentación celular en sólo 100 micrografías.

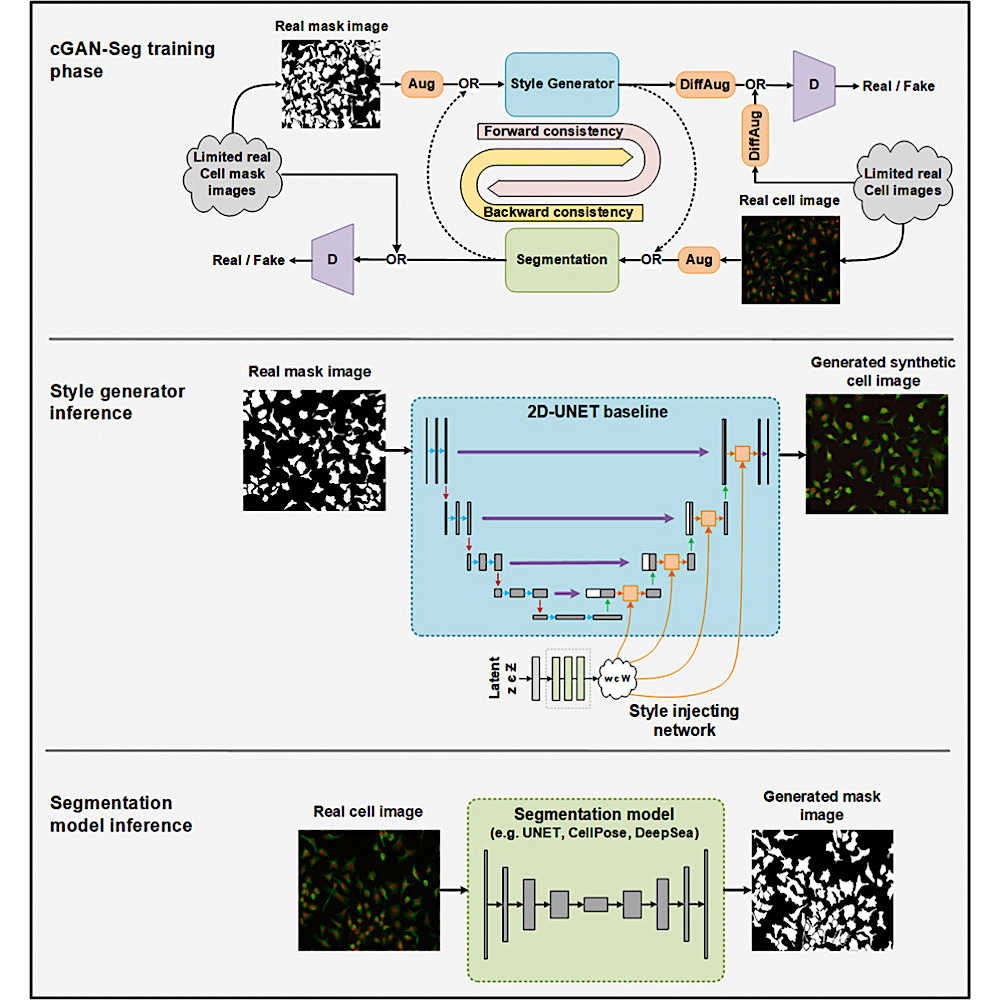

Tres escenarios diferentes de entrenamiento de segmentación celular (a) Entrenamiento de cGAN-Seg en un conjunto de datos limitado de imágenes de células (por ejemplo, 200 muestras de entrenamiento en este artículo) utilizando un diseño personalizado del enfoque CycleGAN, llamado cGAN-Seg, que incluye características como el estilo. inyección Un resaltador PatchGan modificado y una herramienta de zoom de imagen resaltable. (b) Entrenamiento convencional del modelo de segmentación en un conjunto de datos limitado de imágenes celulares. (c) Entrenamiento tradicional del modelo de segmentación en un gran conjunto de datos de imágenes celulares (por ejemplo, 1000 muestras de entrenamiento en este artículo).

El aprendizaje profundo puede acelerar este proceso, pero se necesita un conjunto de datos inicial de imágenes anotadas para entrenar los modelos; se necesitan al menos miles de imágenes como base para entrenar un modelo de aprendizaje profundo preciso. Incluso si los investigadores pudieran encontrar y anotar 1.000 imágenes, es posible que esas imágenes no tengan la diversidad de características que aparecen en diferentes condiciones experimentales.

«Quiere demostrar que su modelo de aprendizaje profundo funciona en diferentes muestras con diferentes tipos de células y diferente calidad de imagen», dijo Zargari. “Por ejemplo, si entrena su modelo utilizando imágenes de alta calidad, no podrá segmentar imágenes de células de baja calidad. Rara vez encontramos un conjunto de datos tan bueno en el campo de la microscopía.

Para abordar este problema, los investigadores crearon un modelo de IA generativa de imagen a imagen que toma un conjunto limitado de imágenes de células anotadas y etiquetadas y genera más, introduciendo características y estructuras más complejas y diversas para crear una variedad de imágenes «sintéticas». las fotos. En particular, puede generar imágenes anotadas con una alta densidad de células, que son particularmente difíciles de anotar manualmente y son particularmente relevantes para estudios de tejidos. Esta tecnología procesa y crea imágenes de diferentes tipos de células, así como diferentes métodos de obtención de imágenes, como las capturadas mediante fluorescencia o tinción histológica.

Zargari, quien dirigió el desarrollo del modelo generativo, utilizó un algoritmo de IA de uso común llamado “red adversaria generativa de ciclo” para crear imágenes fotorrealistas. El modelo generativo está mejorado con las llamadas «funciones de impulso» y una «red de inyección de patrones», que ayuda al generador a crear una amplia gama de imágenes sintéticas de alta calidad que muestran diferentes posibilidades de cómo podrían verse las células. Hasta donde saben los investigadores, esta es la primera vez que se utilizan técnicas de inyección típicas en este contexto.

El generador de patrones cGAN-Seg puede generar imágenes sintéticas a través de múltiples modalidades de imágenes, tipos de células y orgánulos subcelulares (de los conjuntos de datos DeepSea y CellPose) que son similares a imágenes reales y exhiben puntuaciones FID relativamente bajas.

Este conjunto diverso de imágenes sintéticas generadas por el generador se utiliza luego para entrenar un modelo para realizar con precisión la segmentación celular en nuevas imágenes reales capturadas durante los experimentos.

“Usando un conjunto de datos limitado, podemos entrenar un buen modelo generativo. Usando este modelo generativo, podemos crear un conjunto más grande y diverso de imágenes sintéticas anotadas. Usando las imágenes sintéticas generadas, podemos entrenar un buen modelo de segmentación. esa es la idea”, dijo Zaghari.

Los investigadores compararon los resultados de su modelo utilizando datos de entrenamiento sintéticos con métodos tradicionales de entrenamiento de IA para realizar la segmentación celular en diferentes tipos de células. Descubrieron que su modelo produce una segmentación significativamente mejorada en comparación con los modelos entrenados con datos de entrenamiento tradicionales limitados. Esto confirma a los investigadores que proporcionar un conjunto de datos más diverso mientras se entrena el modelo de segmentación mejora el rendimiento.

Con estas capacidades de segmentación mejoradas, los investigadores podrán detectar mejor las células y estudiar la variación entre células individuales, especialmente entre células madre. En el futuro, los investigadores esperan utilizar la tecnología que desarrollaron para ir más allá de las imágenes fijas y crear vídeos, lo que podría ayudarles a identificar factores que influyen en el destino de una célula en las primeras etapas de su vida y predecir su futuro.

«Producimos imágenes sintéticas que también se pueden convertir en una película de lapso de tiempo, donde podemos generar el receptor invisible de las células», dijo Shariati. «Con esto, queremos ver si podemos predecir estados futuros de la célula, como si la célula crecerá, migrará, se diferenciará o se dividirá».

Segmentación celular mejorada con conjuntos de datos de entrenamiento limitados utilizando redes adversarias generativas de ciclosiCiencia (Acceso Abierto)

Astrobiología